UNIVERSITE LIBRE DE BRUXELLES

Faculté des Sciences

Département d’Informatique

MIDI Sans Frontières

Analyse des problèmes relatifs à la communication musicale sur IP

Abstract

Nous proposons, dans le cadre de ce mémoire, d’analyser la possibilité d’intégrer le support d’un langage de description du jeu musical sur un réseau de type IP. Nous commencerons par montrer l’intérêt d’une telle approche à travers différents modèles d’utilisation.

Après une étude de la syntaxe du langage MIDI que nous avons choisi d’adapter pour permettre la communication interactive, nous nous intéresserons aux aspects de la perception qui rentrent en jeu dans la détection des imperfections de transmission.

Par une analyse systématique de scénarios illustrant l’apparition de problèmes de transmission, nous déterminerons les mécanismes à mettre en oeuvre afin de pouvoir minimiser leur incidence.

Nous étudierons ensuite le choix d’une architecture réseau apte à supporter la transmission MIDI, ce qui nous amènera à faire un parallèle avec les implémentations de la téléphonie sur IP pour ensuite nous demander si l’intégration de nos développements dans le cadre du protocole H.323 ne constitue pas un atout indéniable.

L’étude de la gestion de la qualité de service offerte par les réseaux en fonction de notre type d’application nous a finalement paru un détour essentiel pour passer à la phase d’implémentation qui nous permettra de juger de l’applicabilité des concepts abordés.

Remerciements

Je tiens tout d’abord à remercier, M. Vassilis Constantopoulos et M. Joël Cannau, pour la confiance, l’aide et les encouragements qu’ils m’ont accordés durant l’élaboration et la rédaction de ce mémoire.

Je tiens également à remercier mon directeur de mémoire, M. Raymond Devillers.

Je remercie, Mme Marie-Ange Remiche, M. Claude Machgeels et M. Joël Goossens pour avoir accepté de faire partie du jury ; Ainsi que Mme Carolyn Drake et M. Bruno Repp pour l’aide qu’ils m’ont apportée dans le domaine de la perception auditive.

Je voudrais encore remercier Isabelle, Thomas, Christophe, Toan et plus particulièrement Laura qui n’ont pas manqué à cette occasion de me prouver, une fois de plus, leur amitié.

Je remercie enfin chaleureusement ma famille, pour son éternel support.

Merci !

Table des matières

Directeur : Raymond Devillers ii

1Introduction 9

2Le but de l’interaction musicale 12

2.1Le modèle Internet 12

2.2Le modèle Studio 13

2.3Le modèle Serveur de sons 14

3 Le protocole MIDI 16

3.1Comparaison audio et MIDI 16

3.2La communication MIDI 18

3.3Les messages MIDI 20

Les channel messages 21

Les system messages 22

4 Perception musicale 25

5 Analyse des problèmes de transport MIDI 29

5.1Les retards 30

Cas 1 : Retard constant 30

Cas 2 : Retard variable 31

Cas 3 : Inversion 32

5.2Les pertes 33

Cas 1 : Perte du Note On 34

Cas 2 : Perte du Note Off 35

Cas 3 : Perte du Note On et du Note Off correspondant 36

5.3Cas de perte et de retard plus ambigus 36

Cas 1 : Inversion 36

Cas 2 : Perte du Note On et du Note Off correspondant 37

5.4Transport d’autres types de message 38

5.5Conclusion de l’analyse des problèmes de transport 39

6 Intervalle de transmission 41

7 Pré-Analyse du comportement MIDI 45

8 Vérification de l’état du système 50

9Mécanisme d’anticipation 52

10 Choix de l’architecture réseaux 56

10.1Objectifs et contraintes 56

10.2Yamaha mLAN 58

10.3 Choix du modèle TCP/IP 61

La couche Internet 62

La couche transport 64

11 RTP / RTCP 68

11.1RTP 68

La session RTP 69

Le paquet RTP 69

Les fonctionnalités de RTP 71

11.2RTCP Real-Time Control Protocol 72

12 MIDI Versus VoIP 74

13 H.323 76

14 QoS 78

14.1Gestion de la QoS 79

Gestion en meilleur effort 80

Gestion du trafic au sein du réseau 81

Gestion du trafic aux extrémités du réseau 81

14.2Niveaux de service de la QoS réseau 82

14.3Les modèles liés au protocole IP 84

IntServ (RSVP) 84

Diffserv 85

15 Mesure de la qualité 86

16 Implémentation 89

16.1Mise en place des éléments de base 89

Acquisition et reproduction de données MIDI 90

Simulation 91

Expérimentation 94

Générateur de notes 95

Emetteur Récepteur RTP 95

Le relais UDP 96

16.2Mise en place de mécanismes de correction 98

Correction basique 99

Transmission de l’état de l’émetteur 99

Intervalle de transmission de l’état du système 100

Temporisation 101

17 Conclusion 105

Bibliographie 106

Annexes 110

I Code source de l’application 111

II Index des figures et des tables 146

III Liste des acronymes utilisés 151

IV Glossaire 153

Les plus grands changements qui s’opèrent actuellement dans nos sociétés occidentales se caractérisent bien souvent en terme d’information et de communication ainsi qu’en une mondialisation croissante des échanges.

Il peut être étonnant de voir à quel point ces changements concernent tout à la fois les mentalités, les sciences et la technique. Ces différents aspects semblent évoluer dans un même sens.

Parmi ces changements, un des plus spectaculaires et sans nul doute à l’origine de bien d’autres transformations concerne l’informatique. Après s’être répandue dans nos entreprises et chez les particuliers pendant les années quatre-vingts, l’informatique a elle-même été sujette à une intense transformation au cours de la dernière décennie pour se matérialiser aujourd’hui comme un puissant vecteur de communication et d’échange. Avec le développement du réseau Internet, elle change petit à petit notre façon d’apprendre, de comprendre et de connaître. Elle transforme de façon importante certains processus sociaux et a ainsi fait rentrer chaque jour de nouveaux mots dans le langage courant, tels que télétravail, vidéo- conférence, home-shopping, télé-apprentissage, paiement électronique ou bibliothèque électronique.

Par ce biais les frontières géographiques, sociales et même parfois culturelles s’amenuisent de jour en jour, parfois dangereusement, tant l’impact social de ces " avancées " semble être omis.

Néanmoins, il est bien compréhensible que le développement de l’informatique dans les domaines du multimédia et des réseaux, à l’origine de bien d’autres changements, suscite un grand enthousiasme.

Les réseaux informatiques se retrouvent eux-mêmes au cœur d’une inévitable convergence, pour tendre vers un support de tous les médias par une même infrastructure. Ceci pour des raisons économiques (économies d’échelle en particulier), de simplification, de gestion et d’efficacité d’exploitation. Ainsi, de nombreux efforts sont donc aujourd’hui consentis pour la mise en place de réseau supportant aussi bien le transfert de la voix et de l’image que des données. On trouvera donc une large gamme de technologies qui approche au mieux ces buts: ATM, VoIP, H.323, SIP, ISDN, UMTS, etc.

Si la musique est probablement le mode de communication le plus universel, il est normal qu’à ce titre elle occupe une place importante au sein de ce que l’on nomme le multimédia. Internet est sans nul doute devenu la bibliothèque la plus imposante et donne ainsi accès à une somme astronomique d’œuvres musicales en tout genre.

La révolution technologique dans le domaine de la musique est sans répit. Les supports de données, les formats de fichiers, les protocoles de transfert, et les instruments de musique sont sans cesse réétudiés afin de permettre de nouvelles fonctionnalités.

Si l’auditeur ne peut que se féliciter de cette technologie lui permettant d’accéder de tout lieu et le plus rapidement au contenu musical (MP3, streaming, MIDI, etc.), il semble cependant que les musiciens amateurs ou professionnels n’aient pas encore l’opportunité de dépasser les frontières physiques de leur local de répétition ou de leur studio lorsqu’ils désirent composer ou être accompagnés.

Il semble pourtant n’y avoir qu’un pas pour permettre à ceux-ci de réellement tirer parti de toute cette mouvance technologique.

L’objectif de ce mémoire est d’analyser la possibilité d’offrir au musicien un moyen d’interaction efficace à travers les réseaux.

Nombre de technologies sont efficacement exploitées lorsqu’il s’agit de transmettre statiquement l’information sonore ou musicale. La transmission sous cette forme intervient après le travail de l’artiste, lorsque les différentes phases de la composition et/ou de l’interprétation ont abouti au résultat prêt à être « consommé » par l’auditeur.

Nous situons notre étude en amont, lorsque le travail de composition ou d’interprétation musicale est en cours. Nous souhaitons offrir aux musiciens une capacité d’interaction musicale, entre eux ou avec leur matériel, localement ou à distance, pour peu qu’ils disposent d’un accès à un réseau informatique permettant d’échanger les informations utiles.

Tentons d’établir l’intérêt de la démarche à travers un éventail non-exhaustif d’utilisations de cette capacité d’interaction.

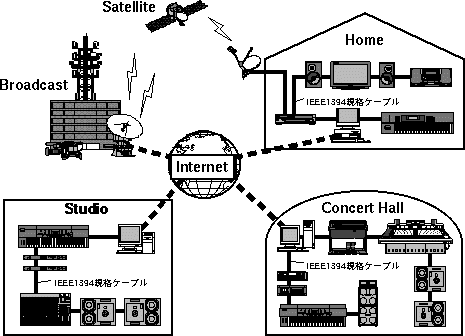

La capacité d’interaction doit permettre aux musiciens physiquement distants de jouer ensemble et simultanément sur leur instrument respectif. C’est ce qui est appelé dans certaines études le télé orchestra [A1]. Avec un tel support, on peut imaginer qu’un claviériste londonien peut se connecter par l’intermédiaire d’un réseau informatique hétérogène à un percussionniste africain afin de communiquer, musicalement. Evidemment l'efficacité d'une telle communication dépendra fortement des performances, de la charge des lignes et des nœuds rencontrés sur le réseau traversé. On peut également intégrer dans ce modèle l’utilisation d’Internet pour le télé-apprentissage de la musique comme le suggère l’approche de J.P. Young «Piano Master Classes via the Internet». [A2]

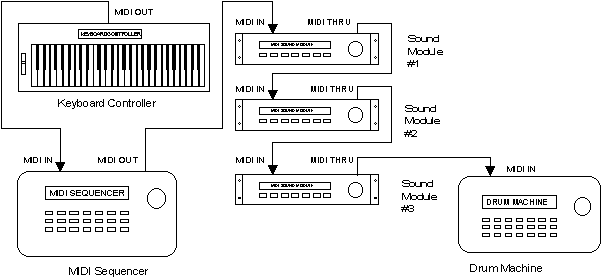

Figure 1 : Le modèle Internet

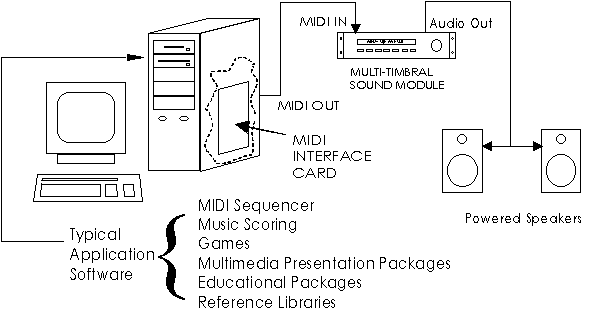

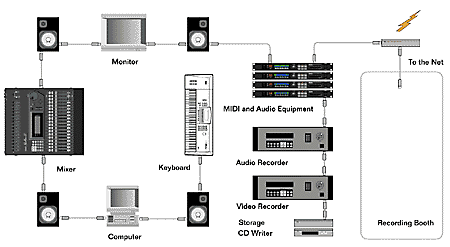

La capacité d’interaction, prévue pour être supportée sur un réseau, permet également la simplification des multiples connexions établies dans les studios musicaux. En effet, à l’heure actuelle la diversité des câblages et des types de données échangées (données, audio numérique, audio analogique, MIDI … ) ne font que rendre beaucoup plus complexe la gestion de ce type d’infrastructure. L’idée est dans ce cas d’adjoindre à ces équipements musicaux toutes les fonctionnalités pour supporter un protocole réseau classique au même titre qu’une imprimante réseau et donc de ne plus trouver dans le studio qu’un « simple réseau » informatique supportant tous les échanges. Nous montrerons également comment les schémas d’adressage des réseaux informatiques permettent de s’affranchir de la limite du nombre d’instruments accessibles d’un point à l’autre dans les architectures de réseaux MIDI actuels.

On peut noter l’approche en ce sens du constructeur Yamaha dans le développement de son système mLAN (Voir 10.2) permettant de supporter le MIDI et l’audio sur une infrastructure basée sur le protocole IEEE1394 (FireWire).

Figure 2 : Le modèle Studio

Nous pouvons envisager la mise en œuvre sur des réseaux suffisamment rapides d’un système permettant d’avoir de très puissants synthétiseurs sonores qui à la réception d’informations en provenance de musicien transforme celles-ci en signaux audio et les retransmette vers leur expéditeur. Ceci consiste en quelques sortes à avoir une sorte de terminal musical "bon marché" et de partager les ressources sonores d’un serveur. Il faut dans ce modèle un réseau rapide car les informations retournées souffrent d’un besoin de qualité qui implique un haut débit ainsi qu’un besoin de temps réel.

Figure 3 : Le modèle serveur de sons

La norme MIDI [I1] (Musical Instrument Digital Interface) définit une interface et un protocole permettant de mettre en relation différents instruments de musique afin qu’ils puissent communiquer. MIDI est largement accepté et utilisé par les compositeurs et musiciens depuis sa conception en 1982/1983.

Les instruments de musique dotés de l’interface MIDI ont donc la possibilité d’échanger des messages qui ne contiennent pas le son tel qu’il doit être produit, mais une indication sur l’action à effectuer.

MIDI a également évolué pour devenir une méthode de représentation électronique archivable du jeu musical qui rend ce protocole aussi intéressant pour les compositeurs et musiciens que pour l’utilisation dans les applications informatiques qui produisent du son.

Contrairement aux systèmes audio, MIDI se contente d’indiquer aux générateurs de sons avec lesquels il travaille (localement ou à distance) les opérations qu’ils doivent effectuer.

MIDI fournit aux générateurs de sons des informations équivalentes à celles que l’on pourrait relever sur une partition. C’est la différence qui existe entre le fait de jouer d’après une partition sur un piano et l’action de placer un CD audio dans un système Hi-Fi afin d’en découvrir le contenu.

Alors qu’en audio numérique, Shannon nous indique qu’un son (notion plus générale qu’une note) doit être échantillonné et mesuré à une fréquence double de sa fréquence maximale pour pouvoir le restituer fidèlement, une note en MIDI ne sera représentée que par quelques valeurs numériques : sa hauteur en fréquence matérialisée par un numéro de touche sur un clavier, l’intensité à laquelle elle doit être générée, ses instants d’apparition et de disparition, ainsi que le numéro de forme d’onde que le générateur doit utiliser. (Bien que cette dernière information ne soit envoyée qu’une fois pour toute la durée de l’utilisation de ce timbre). Ces informations suffiront au générateur de son pour faire le reste.

Il n’est donc pas difficile de comprendre pourquoi la représentation MIDI a une taille beaucoup plus compacte que l’information musicale équivalente dans le format audio le plus compressé.

Il est cependant essentiel de remarquer que le faible volume occupé par les donnés MIDI se traduit par l’absence d’informations relatives à la nature même du son utilisé (la spécificité du timbre). La production sonore réelle, orchestrée par MIDI, sera donc fortement influencée par les caractéristiques du générateur de sons utilisé.

Cette différence de qualité met en évidence un phénomène assez rare : en transmettant un message, la qualité de restitution du son transmis par MIDI peut être plus élevée à la réception si l’instrument qui envoie les instructions est de moindre qualité.

Afin de permettre l’échange de fichier standard MIDI et d’éviter de rendre les différences d’interprétation d’un générateur à l’autre trop contraignantes, la norme Général MIDI définit un ensemble de 128 timbres répondant à certaines caractéristiques bien précises que les générateurs MIDI conformes doivent implémenter. Cependant la qualité de synthèse de ces sons pourra varier d’un instrument à l’autre et une gamme plus spécifique à chaque constructeur pourra se retrouver à côté de cet ensemble de sons.

|

|

MIDI |

DIGITIZED AUDIO |

|

Volume |

+ Faible |

- Comparativement élevé |

|

Reproduction sonore |

- Dépend fortement du générateur |

+ Relativement fidèle. (DAC et amplification peuvent générer des différences) |

|

Modification |

+ Edition très simple |

- Traitements complexe du signal |

Table 1 : Comparaison MIDI et Audio

MIDI fournit un moyen standard et efficace pour transporter les données musicales sous forme électronique. Les informations MIDI sont transmises dans des « Messages MIDI ». L’équipement qui reçoit le message doit générer le son réel.

La spécification MIDI 1.0 [I1] fournit une description complète du protocole MIDI.

Le flux de données MIDI est un flux de bit asynchrone unidirectionnel à 31.25 Kbits/sec, avec 10 bits transmis par mot (un bit Start, 8 bit de données, et un bit Stop).

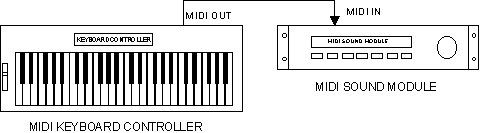

La communication MIDI se déroule entre équipements qui peuvent jouer les rôles de maîtres et/ou d’esclaves. L’équipement maître doit être capable d’émettre des informations vers l’esclave qui pour sa part doit être capable de pouvoir les traiter. Pour être maître, l’équipement doit posséder une sortie (MIDI OUT), pour être esclave l’équipement doit posséder une entrée (MIDI IN). Les messages sont envoyés de la sortie (MIDI OUT) du maître vers l’entrée (MIDI IN) de l’esclave au travers d’un lien unidirectionnel, matérialisé par un câble coaxial. On notera qu’une communication bidirectionnelle implique la présence de deux liaisons physiquement distinctes entre les équipements.

Figure 4 : Configuration simple, Maître - Esclave

Afin de pouvoir connecter en chaîne plus de deux équipements, on trouve souvent à côté de l’entrée MIDI IN, une sortie de relais (MIDI THRU) qui retransmet l’information telle que l’équipement l’a reçue à l'équipement suivant dans la chaîne.

Figure 5 : Chaînage MIDI

Un instrument MIDI classique fonctionne sur 16 canaux parallèles. On peut affecter un timbre différent à chaque canal et donc le générateur peut produire un ensemble de sons variés simultanément. Cette propriété est appelée la multi-timbralité.

Etant donné l'aspect série de la communication, on peut mettre en évidence l'aspect multiplexage qui s'applique dans la mesure où 16 canaux différents utilisent le même lien. Il s'agit donc d'un multiplexage temporel statistique étant donné que les infos ne sont envoyées qu’au moment ou une émission est nécessaire.

Figure 6 : Configuration MIDI avec ordinateur

Les messages MIDI [A3] se composent d’un byte de statut (status byte) qui est généralement suivi par un ou deux bytes de données (data bytes).

On trouve deux classes principales de messages MIDI : ceux qui concernent un canal spécifique, channel messages (canal indiqué dans le byte de statut), et les system messages plus généraux.

Les channel messages sont de deux types : channel voice et channel mode.

Les channel voice messages transportent l’information musicale qui doit être délivrée au générateur de son.

Le Note On signale l’activation d’une touche (numéro de canal dans le byte de statut, le numéro de la touche enfoncée et la vélocité (pression exercée) dans chacun des deux bytes suivants).

Le Note Off est transmis lorsque la touche précédemment activée est relâchée. Il indique également le numéro de touche, ainsi que la vélocité avec laquelle la touche avait été actionnée (généralement ce paramètre est ignoré par les instruments).

L’Aftertouch : sur certains claviers MIDI, il est également possible de mesurer la pression exercée lors du relâchement des touches. (contrôle du vibrato). Selon le type de clavier on utilisera un message :

Le Polyphonic Key pressure: les informations de pression sont différentes pour chaque touche : channel + key + pressure.

Le Channel Aftertouch : une info de pression unique est utilisée pour tout le clavier : channel + pressure.

Le Pitch Bend indique les changements de position de la roulette d’un clavier qui permet d’offrir un passage plus progressif d’une note à l’autre. Deux bytes de données offrent une précision suffisante pour que le déplacement de la « roulette » paraisse continu.

Le Program Change spécifie le « type d’instrument » qui doit être utilisé par le générateur pour produire les sons d’un canal donné. Ce message ne nécessite qu’un byte de données pour indiquer le nouveau numéro de programme : 128 instruments possibles par banque de programme.

Le Control Change permet de contrôler une large variété de fonctions d’un générateur de sons et ne concerne qu’un canal spécifique. Msg Type + Channel + Controller Number + Control Value. Il en existe toute une liste détaillée dans la spécification de MIDI 1.0.

Les messages channel mode affectent la façon dont l’instrument répond aux messages MIDI. Les messages Omni On et Omni Off indiquent si l’instrument doit traiter les informations qu’il réceptionne sur tous les canaux. Les messages Poly On et Poly Off indiquent si l’instrument doit prendre en compte plusieurs notes simultanément, s’il accepte la polyphonie.

Il en existe de trois types : system common, system real-time et system exclusive.

Ce message concerne l’ensemble des récepteurs et active les fonctions de synchronisation, de sélection et ou de positionnement de certains équipements ne respectant pas la norme MIDI.

Ce message permet de synchroniser tous les équipements MIDI d’un système (séquenceur, boite à rythme). Les claviers ignorent normalement ce genre de message. Ces messages sont prioritaires sur les autres messages et peuvent apparaître n’importe où dans le flux de données (par exemple entre le byte de statut et le byte de données d’un autre message MIDI).

Timing clock

Start

Continue

Stop

Ce sont des messages dont le contenu est laissé à l’appréciation de de chaque constructeur particulier. La norme MIDI précise juste que le message doit débuter par un numéro d’identification du constructeur et qu’un fanion particulier (EOX) indique la fin du message. La taille des messages system exclusive peut donc varier. La mise à jour de l’OS d’un synthétiseur peut par exemple se faire de l’ordinateur vers le synthétiseur à travers la connexion MIDI, sous la forme d’un tel message.

|

MIDI byte: |

Status byte: |

Data byte: |

|

|

|

|

|

This first bit is always used to indicate whether byte is 'Status' or 'Data' |

Lowest four bits used for MIDI channel number, leaving only three bits for actual instruction |

As a data byte is always associated with the preceding Status byte, no channel number is needed, leaving seven bits free for actual data |

|

MIDI Message: |

||

|

|

|

|

|

First byte is always 'Status' |

Usually followed by one or two 'Data' bytes |

|

|

|

||

Figure 7 : Structure des messages MIDI

|

Command |

Number of Data bytes

|

Title |

|

|

Bin |

Dec |

||

|

1000XXXX |

128+X |

2 |

Note Off |

|

11110000 |

240 |

???? |

System

Exclusive |

|

XXXX is the MIDI

channel number.

|

|||

Table 2 : Les instructions MIDI et les bytes de données correspondants

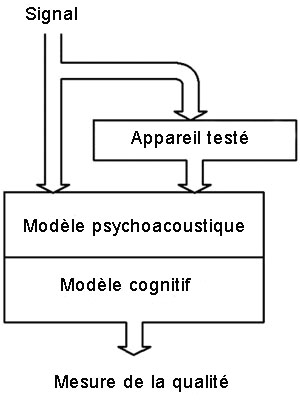

A la question « Que faut-il pour que les musiciens puissent interagir au travers d’un réseau ? » ; nous aurions tendance à répondre très promptement en terme de débit, de qualité de service, de gigue minimum, etc. Si ces aspects ont une influence énorme sur toute communication électronique, il faut cependant d’abord mieux identifier qui est le vrai récepteur des informations transmises, c’est à dire, dans notre cas, le musicien. Sous cet angle une réponse correcte à la question est : « Il faut qu’ils ne se rendent pas compte de l’existence du réseau entre eux ». Cette réponse simpliste évoque pourtant l’importance de considérer que le but est de rendre la transmission transparente et non pas de la rendre techniquement parfaite.

Une analogie peut-être faite avec les systèmes vidéos, en effet si la vue ne nous permet pas de saisir plus de 24 images par seconde, il existera peu d’intérêt à développer des téléviseurs capables d’afficher à des cadences plus élevées.

Ainsi, une première étape dans le développement de notre système est d’appréhender les fonctions perceptives impliquées lors du jeu. Je tiens particulièrement à remercier Mme Carolyn Drake (chercheur au CNRS CR1, Equipe Perception Auditive ) et M. Bruno Repp (Senior Scientist, Haskins Laboratories) pour les informations et les réponses qu’ils m’ont très aimablement fournies dans ce domaine.

Nous allons donc ici rassembler les résultats de psychoacoustique ou de psychologie expérimentale qui nous permettrons premièrement de mieux comprendre les mécanismes mis en place lors du jeu et d’autre part d’évaluer certains seuils perceptifs.

Le caractère important de l’interaction dans le jeu est le synchronisme qu’il nécessite. En effet les musiciens lorsqu’ils jouent à plusieurs doivent être capables de «poser» leur jeu sur une échelle de temps, un tempo qu’ils établissent. On peut donc se demander comment est-ce qu’ils procèdent pour parvenir à se synchroniser.

Il apparaît que le musicien déduit le rythme de la séquence qui précède son jeu et agit par anticipation. Cette affirmation est appuyée par certaines expériences de psychologie expérimentale. Lorsque l’on demande à un individu d’accompagner le rythme produit par un son répété à intervalle régulier, on pourra constater que l’action de l’individu va toujours légèrement précéder le rythme sur lequel il se base, ce qui montre qu’il se base sur les sons précédents.

La faculté d’anticipation peut aussi permettre au musicien de pallier aux temps de réponse présentés par un instrument. Nous entendons ici par temps de réponse, le temps écoulé entre l’activation d’une touche d’un clavier et l’apparition réelle du son généré par cette action. Nous pouvons illustrer ce phénomène par la faculté d’anticipation dont les organistes font preuve lors de la manipulation de leur instrument qui peut présenter des temps de réponse de plusieurs secondes.

L’anticipation est un phénomène naturel pour l’être humain car lui-même lorsqu’il agit se voit contraint de tenir compte de la différence de temps de réponse entre le système nerveux et le système moteur.

Il est tout aussi intéressant de pouvoir établir la précision temporelle de la perception auditive. L'oreille ménage un temps de réponse, elle distingue clairement deux événements sonores successifs à partir d'un délai minimal de 50 ms. Au-dessous de ce seuil, la sensation glisse doucement de la perception d'un rythme à celle d'une note dont la fréquence est fixée par la cadence des répétitions. Isolé, un battement sec de tambour sera entendu comme un choc furtif. Répété 440 fois par seconde, le tambour disparaît pour laisser place à un la totalement virtuel, créé par nos sens comme l'est la perception du mouvement de l'image animée. Sous les 50 ms la précision va également dépendre d’autres caractéristiques. Pour un son dont l’attaque est rapide la sensibilité de l’oreille pourra être très forte, on peut dans ce cas distinguer un intervalle de 2 ms. Toutefois, en musique, on peut considérer 20 ms comme un seuil tolérable.

Cette considération est importante lorsque nous essayons de calculer la vitesse d’un jeu musical afin de contrôler les paramètres de transmission et/ou d’établir certains délais acceptables. On peut se baser pour le calcul de cette vitesse de jeu sur le nombre d’événements par unités de temps sur un intervalle. Nous obtenons alors des résultats du type 14 actions par seconde.

Imaginons cependant, que le musicien durant la durée d’un intervalle de 4 secondes joue 4 accords de 4 notes chacun, il faut donc considérer que la vitesse est de 1 événement par seconde, car rythmiquement jouer un accord correspond à 1 événement unique. Malheureusement rien ne va nous indiquer que la suite rapide de 4 notes que nous rencontrons chaque seconde est un accord, il faudra donc pouvoir grouper les événements qui se situent dans un certain intervalle et les considérer comme simultanés [A3], pour qu’automatiquement nous ne calculions pas une vitesse du jeu égale à 16 événements par seconde.

Si le réseau sur lequel nous transmettons ne délivre pas les informations d’une manière régulière il devient intéressant de savoir dans quelle mesure cette dégradation est perceptible. Bien que le seuil de détection de gigue temporelle dans la musique ne soit pas encore déterminé, on peut estimer que la gigue est difficilement décelée si elle ne représente pas plus de 3% de l’intervalle minimum entre les notes d’une séquence. Les concepts de discrimination temporelle sont largement exposés dans les travaux de Sorkin [A4].

Il est à noter que lors de la plupart des expériences réalisées dans le domaine de la perception, toute l’attention du sujet se porte sur la détection de ce type de différence, ce qui n’est pas le cas lors de nos transmissions MIDI, donc les niveaux de tolérance peuvent généralement être un peu plus élevés que ce que de tels résultats expérimentaux suggèrent.

Les messages MIDI comparativement à d’autres informations à caractère temps réel que nous pouvons transporter sur un réseau présentent l’avantage de ne demander qu’un débit limité. En revanche, l’interaction MIDI exigera des délais de transmission et de traitement relativement faibles pour rendre une impression de simultanéité. De plus nous pouvons montrer que les erreurs pouvant apparaître nécessitent souvent d’être détectées et corrigées afin de ne pas influencer la suite de la session musicale.

Afin d’établir les procédures de contrôle de flux, d’erreurs et de qualité de service que nous pouvons et/ou devons mettre en place pour un transport fiable des données sur notre réseau, il est indispensable d’analyser les problèmes que nous pouvons rencontrer lors du transfert des messages MIDI.

En première approche nous analyserons le transport des messages Note On, Note Off qui sont les plus communs lors d’une session MIDI. Nous analyserons ensuite les autres classes de messages pour lesquels les traitements seront plus au moins proches de ceux requis par ces premiers messages.

Nous analyserons les contraintes du transport MIDI au niveau de l’émetteur et du destinataire, c’est-à-dire les systèmes d’extrémités. Bien que nous nous rendrons vite compte que l’impact des systèmes intermédiaires est loin d’être négligeable nous n’essayerons à aucun moment d’avoir un quelconque contrôle à ce niveau. Ainsi tout développement ou application de ces observations se matérialiseront sur les systèmes de bout en bout, éventuellement en fonction des systèmes intermédiaires.

Plus concrètement nous travaillons au minimum au niveau de la couche transport du modèle OSI (systèmes intermédiaires = commutateur, routeur, lien).

L’analyse de chaque cas est réalisée de manière indépendante. Au cours de cette analyse nous évaluons la manière dont le récepteur réagit sur base des informations fournies selon la norme MIDI. Les solutions qui apparaissent lors de l’analyse d’un cas problématique ne sont donc pas automatiquement reportées aux cas suivants. En conclusion de cette analyse, nous évaluerons donc les mécanismes nécessaires pour la résolution de l’ensemble des problèmes rencontrés.

Le meilleur cas dans lequel nous pourrions nous trouver lors de la transmission de nos messages MIDI est celui d’un retard constant très faible et une absence totale de perte ou d’erreur. Dans ce cas nous ne pouvons qu’espérer que le retard soit suffisamment faible pour permettre d’avoir une impression de simultanéité et nous pourrons alors directement transmettre le message vers le générateur de sons. On peut expliquer ce retard par le temps constant de propagation du signal à travers les lignes de transmission additionné au temps de traitement (négligeable dans la plupart des cas) à travers les différents nœuds rencontrés sur le réseau.

Figure 8 : Retard constant

Imaginons une situation moins idéale mais plus proche de la réalité. Le réseau ne délivre pas tous les paquets à la même vitesse. La gigue peut subvenir à cause de la disparition ou de l’apparition de trafic externe sur les équipements du réseau que les paquets traversent ou par le changement de la route que nos paquets empruntent lors de leur acheminement. Pour que le récepteur se rende compte d’une telle situation, il faut, soit, que les paquets comportent un horodatage qui permette d’évaluer le temps de transmission, soit qu’ils soient envoyés à intervalles réguliers mêmes s’ils ne contiennent pas d’infos.

Figure 9 : Retard variable

Nous pouvons résoudre ce type de problème de deux manières :

Soit, on va systématiquement uniformiser les délais des messages dans le temps en utilisant une mémoire tampon, ce qui en pratique consiste à augmenter le délai pour les paquets arrivant très rapidement ! Mais cela peut résoudre le problème si le délai de temporisation nécessaire reste suffisamment faible pour préserver la dynamique de réponse que les musiciens peuvent s’attendre à rencontrer. Il s’agit donc de faire un compromis entre gigue et délai moyen de réponse !

Soit, nous jugeons qu’il vaut mieux prendre en compte les notes dès qu’elles arrivent sans temporiser car le délai induit nécessaire n’est pas acceptable en regard du seuil de retard maximum à préserver pour conserver l’impression de simultanéité. Dans cette optique il reste donc encore à décider s’il faut jouer les notes tardives ou pas. Il n’est pas aussi évident de trancher qu’il y paraît.

Les Notes ne nous arrivent pas dans l’ordre d’émission, ce problème peut se présenter si le protocole que nous utilisons ne garantit pas la séquence chronologique de réception de paquet et qu’au moins deux routes différentes ont été utilisées lors de l’acheminement de nos Paquets.

Figure 10 : Inversion de messages

Le paquet devra contenir une information de séquence ou un horodatage pour pouvoir détecter ce type de problème. Le stockage par le récepteur d’informations sur les dernières notes reçues permettrait de détecter en partie la cohérence des notes reçues étant donné qu’après un Note On d’une touche on ne peut recevoir pour la même touche qu’un Note Off et vice-versa.

Les mêmes alternatives s’offrent à nous et il est toujours possible que le Note On doive être pris en compte malgré que l’indication contraire nous soit déjà parvenue. Il s’agit toujours de déterminer s’il faut jouer les notes tardives.

Dans ce troisième cas, à condition de garder trace des derniers messages reçus, nous pouvons savoir dès que nous recevons un Note Off si Note On nous a échappé et donc décider de la manière de remédier à cette situation avant même de recevoir le message manquant. Il faut toutefois qu’un horodatage ou un numéro de séquence nous permette d’être sûr qu’il ne s’agisse pas d’un ancien Note On retardé par le réseau.

La perte de paquets peut subvenir pour diverses raisons ; un équipement du réseau peut constater la corruption des données qu’il réceptionne ou subir une telle saturation qu’il n’est plus capable de procéder à l’acheminement des paquets. Les routeurs pour éviter la prolifération de paquets perdus sur le réseau peuvent également supprimer un paquet jugé trop âgé.

Nous traiterons de la perte dans l’optique où nous n’allons pas utiliser un mécanisme de retransmission sur demande (une justification précise de ce choix est exposée dans la partie « Choix du modèle TCP/IP » page 63 ) dans la mesure où, le temps nécessaire à constater la perte additionné au temps nécessaire à transmettre la demande de retransmission et le délai induit par la retransmission elle-même nous mèneraient à un délai total qui ne semble pas acceptable dans notre système.

La détection de la perte va fortement dépendre de l’implémentation du protocole, mais il paraît déjà évident qu’une temporisation à elle seule ne va en aucun cas permettre de corriger notre problème dans le cas présent et donc ne sera pas suffisante puisque l’impact d’une perte peut-être très important.

La perte d’un Note On au sens du protocole MIDI, c’est à dire si le contenu du message transmis ne comporte que les informations spécifiées par la norme MIDI, ne pourra être détectée que lors de la réception du message Note Off correspondant. Cette détection tardive suppose de plus que le récepteur conserve une trace des messages qu’il transmet vers le générateur afin de pouvoir à tout moment vérifier le statut actuel d’une note particulière (actif ou non-actif). Si aucun traitement n’est effectué, le fait de transmettre un message Note Off au générateur pour une note non-active n’aura toutefois pas d’effet.

Figure 11 : Perte du message Note On

Si l’émetteur peut fournir une information supplémentaire telle qu’un numéro de séquence ou une somme de contrôle calculée d’après ce qui a déjà été envoyé, le récepteur pourra vérifier qu’il se trouve bien dans l’état normal et il sera possible de détecter tout problème de perte dès la réception d’un message contenant cette information. Il est à remarquer que selon cette approche un retard peut d’abord être considéré comme une perte par le récepteur. Cette information supplémentaire pourra être envoyée à intervalle régulier et/ou transportée par les éventuels autres messages véhiculés (autres notes sur le même ou un autre canal). Rappelons encore qu’il sera parfois nécessaire de décider s’il faut jouer une note qui n’est plus en statut On.

Ce cas nous montre un problème symétrique au cas précédent, il illustre la faiblesse d’une solution consistant à ne pas réagir aux pertes, en effet dans ce cas l’action du générateur va se poursuivre et le son produit restera audible jusqu'à ce qu’éventuellement une autre note identique vienne activer puis désactiver le générateur.

Figure 12 : Perte du message Note Off

Ce cas est particulièrement intéressant car il nous montre comment une erreur peut influencer toute la suite d’une session musicale ou pour le moins une partie non négligeable. Il faudra donc obligatoirement avoir une information qui permette de vérifier au moins à intervalles réguliers que le générateur est dans un état conforme aux attentes.

Ce cas illustre la perte possible de la Note On et de la Note Off correspondante.

Les observations faites pour les cas 1 et 2 nous permettent de conclure immédiatement que si un numéro de séquence permet de détecter un problème, seule une forme de redondance régulière va nous permettre d’identifier clairement le problème. En effet, sans informations supplémentaires nous ne pouvons pas déduire quel était le contenu du message perdu.

Figure 13 : Perte du message Note On et du message Note Off correspondant

Les cas 1 et 2 nous montrent la possibilité existante de confondre différentes informations se rapportant à une même note MIDI quand le service rendu par le réseau n’est pas fiable.

Ce cas met en évidence le problème qui peut surgir si les différentes routes empruntées par les informations transmises entraînent une inversion des messages. Le Note On 2 va être prématurément annihilé par le Note Off 1 en retard. La solution qui consiste à avoir un horodatage dans les messages peut résoudre le problème. Si la gigue reste faible on peut imaginer résoudre ces problèmes par une temporisation chez le récepteur.

Figure 14 : Ambiguïté lors de l’inversion de messages

(Figure 15) Le deuxième cas nous montre, hélas, que l’horodatage ne sera pas suffisant, en effet si les seules informations reçues sont le Note On 1 et le Note Off 2, l’horodatage ne permettra pas de détecter qu’une erreur s’est glissée, pas plus d’ailleurs qu’une table contenant les Notes actives dans le générateur. Il faut donc impérativement fournir une information permettant de détecter précisément la perte de données.

Il nous faut donc soit fournir un numéro de séquence à chaque message, soit avoir une information supplémentaire (somme de contrôle, redondance) qui va permettre de vérifier l’absence d’erreur.

Figure 15 : Ambiguïté lors de la perte de messages

Analysons maintenant les précautions à prendre dans le traitement d’autres messages :

Le message program change indique que sur un canal spécifié un changement de son a été introduit. Nous ne devons pas permettre qu’un son soit généré avec le mauvais programme. Nous veillerons à mettre en place un mécanisme permettant d’éviter les erreurs de ce type. Le traitement pour les control change sera analogue.

Les messages SysEx sont des messages qui ne rentrent pas vraiment dans le jeu musical, ils peuvent donc être traités avec des mécanismes d’accusés de réception et de retransmission similaires à ceux mis en place par TCP/IP.

Les messages Pedal On/Off concernent l’activation de la pédale qui permet de maintenir actifs, à l’aide du pied, les sons joués après son activation et jusqu'à son relâchement, elle retarde donc l’effet du relâchement de touche, transmis par un Note Off. Il est donc plus prudent que le récepteur lui même cesse de retransmettre les messages Note Off quand la pédale est activée afin d’éviter, qu’un Note Off ne soit reçu avant le message Pedal On et que le son soit donc désactivé par le générateur. Il ne faut, lors du relâchement de la pédale, que désactiver les notes pour lesquelles un Note Off a été reçu durant l’activation de la pédale.

Résumons les observations que l’analyse des différents scénarios nous a fournie et choisissons les mécanismes à mettre en place pour faire face aux problèmes rencontrés.

Une mémoire tampon peut être utilisée pour autant que les temps de transmission et de temporisation (des 2 cotés) restent acceptables. Elle va permettre de supprimer la gigue de faible amplitude.

Dans un réseau non fiable l’usage de l’horodatage est indispensable pour évaluer le retard, il n’est cependant pas suffisant à lui seul car il ne permet pas la détection des erreurs. Les numéros de séquence et/ou les sommes de contrôle peuvent apporter une solution à ce type de problème qui nécessite réellement d’être pris en compte de par la dégradation importante qu’une unique perte est susceptible d‘occasionner sur le jeu musical.

Il faut réfléchir au mécanisme à adopter pour permettre au récepteur de vérifier si l’état dans lequel se trouve le système est conforme. Ces considérations seront d’autant plus importantes que les pertes de plusieurs paquets successifs sont possibles (perte en rafale) et que la remise à jour en cas de décrochage du récepteur doit être rapide.

Nous avons constaté que MIDI par lui-même n’est pas suffisamment riche pour nous permettre de juger de l’action à entreprendre en cas de perte ou de retard. Nous n’avons pas une connaissance suffisante du comportement du générateur, ce qui pose un problème quant à notre façon de prendre les décisions les plus adaptées dans certaines situations.

Bien que nous ayons principalement traité de la transmission sur un seul canal, les concepts se reportent facilement aux cas où plusieurs canaux MIDI sont utilisés. Il est à noter que logiquement l’émission ne met en jeu qu’un seul canal alors que la réception peut impliquer plusieurs canaux quand plusieurs instrumentistes sont impliqués dans la communication.

L’intervalle de transmission est le temps écoulé entre l’envoi de deux paquets successifs sur le réseau.

Il faut choisir un intervalle de transmission suffisamment petit pour garder un bon rendu musical et suffisamment grand pour réaliser l’économie en termes de bande passante.

Evidemment comme on ne peut pas insérer un message dans un paquet qui est déjà parti, l’instant d’émission d’une information est par défaut un plafond relativement à l’instant d’apparition de l’événement concerné, il faut à nouveau être très prudent car il s’agit d’un délai supplémentaire. Ce qui nous entraîne à considérer la somme :

(Moment de l’envoi du paquet – Moment de l’événement ) + Temps de transmission + Eventuel temps de temporisation chez le récepteur. Ce délai devra rester acceptable pour que la structure temporelle du jeu soit respectée.

Figure 16 : Intervalle de transmission

La Figure 16 illustre la situation dans laquelle le délai avant transmission d’un événement se rapproche de l’intervalle de transmission lui-même.

On peut se demander s’il y a un intérêt à envoyer des paquets à intervalles réguliers au risque qu’ils ne contiennent pas d’informations utiles pour le récepteur.

Si on le fait, le numéro de séquence peut remplacer efficacement l’horodatage. Temps = (N° de séquence * Durée d’intervalle)

Si on ne le fait pas, il faut soit l’horodatage pour se réaligner, soit indiquer le nombre de saut de paquet effectué relativement à une fréquence d’envoi supposée. Il faudra dans ce cas garder en plus le numéro de séquence afin de savoir si on a un saut de paquet dû à une perte ou dû à l’absence d’information à transmettre.

Voyons si l’ajout d’un horodatage dans chaque paquet de données réelles est plus lourd que l’envoi systématique de paquets

- SC = surcharge dans les couches inférieures en bytes.

- H = Nombre de byte pour l’horodatage ou le saut de paquet.

- D = taille des données utiles dans le paquet.

- TP = Nombre de bytes de toutes les autres infos du paquet.

- N = Nombre de paquet contenant réellement des données par unité de temps.

- F = Nombre de paquets envoyés par unité de temps quand on procède à l’envoi régulier.

Si l’envoi est réalisé sur base régulière, nous obtenons un débit en byte par unité de temps = (F – N) * (SC + TP) + N (SC + TP + D)

Si l’envoi est réalisé seulement quand l’info est présente. Envoi avec horodatage, nous obtenons un débit en byte = N * (SC + TP + H + D)

MIDI nécessite un intervalle de transmission relativement court pour pouvoir quantifier temporellement les paquets avec suffisamment de précision. Mais contrairement à la situation en audio, il n’y a pas souvent de paquet à émettre relativement à la précision que nous souhaitons atteindre. Donc F doit être beaucoup plus grand que N. Nous avions vu (page 28) que la gigue temporelle n’est pas décelée si elle ne représente que 3% de l’intervalle minimum entre les notes. Choisissons cependant une valeur minimale pour F = 10 N.

SC, la surcharge à laquelle IP participe, est importante, nous pouvons donc considérer que la transmission systématique à intervalle régulier ne sera pas intéressante. Si nous imaginons une transmission par le protocole RTP (Real Time Protocol) [A6] au-dessus de UDP (User Datagram Protocol), la surcharge due à l’encapsulation par les couches inférieures nous donne déjà à elle seule une valeur minimum de surcharge de 40 bytes (IP+UDP+RTP). (voir 10.3 Choix du modèle TCP/IP).

Nous estimons que les données elles-mêmes peuvent être représentées par 20 Bytes et l’horodatage peut être codé avec 4 Bytes.

Le rapport entre l’envoi régulier et l’envoi uniquement quand les données sont disponibles nous donne alors

( 9 * (40 + TP) + (40 + TP + 20)) / (40 + TP + 4 + 20) = 420 + 10TP / 64 + TP

Donc, dans notre cas l’envoi régulier est loin d’offrir un service intéressant. Il faut cependant nuancer cette affirmation, car une compression de la pile IP+UDP+RTP existe mais n’est applicable que pour les liaisons point a point. [A7]

Si l’utilisation d’un intervalle de transmission constant n’est pas adaptée, un petit intervalle de temps entre la réception d’information et la transmission permet de regrouper les événements quasi-simultanés pour une transmission unique. Imaginons que le musicien joue un accord de par exemple 5 notes. Lors de l’arrivée de la première note à l’émetteur de paquet, on peut attendre un temps restreint pour récupérer les autres notes activées simultanément. Dans ce cas, on peut transmettre les différentes notes dans le même paquet et ainsi épargner la surcharge due à l’encapsulation. Une estimation du seuil temporel minimal pour que les événements soit perçus comme simultanés à été donné dans la partie 4 : Perception musicale.

Nous avons pu constater à plusieurs reprises que le manque d’informations concernant le comportement du générateur de sons nous posait des problèmes quant à la prise de décision dans les situations complexes.

La question est de savoir d’une part si des informations supplémentaires peuvent nous être utiles et d’autre part si l’usage d’informations qui ne sont pas à la base disponibles va rendre notre procédé difficile à mettre en œuvre dans une installation MIDI classique.

Commençons par voir comment le générateur produit les sons en fonction des informations MIDI qu’il reçoit. Les instruments de musiques MIDI génèrent leurs sons en faisant varier l’amplitude du signal émis selon une enveloppe prédéterminée (voir Figure 17).

La production sonore passe par généralement par 4 étapes :

Attack

Decay

Sustain

Release

Chaque son a une caractéristique ADSR (Attack, Decay, Sustain, Release) différente, l’attaque d’un violon par exemple sera beaucoup plus progressive que celle d’un piano. Une forte modification des caractéristiques ADSR empêche un instrument d’être reconnu.

L’amplitude de l’enveloppe elle-même dépendra de la pression exercée lors de l’activation de la touche.

Bien que l’émetteur connaisse le temps entre le début de l’attack et la fin du sustain puisque qu’il retransmet ses informations, il ne dispose pas au départ d’informations sur la durée des différentes phases et leurs amplitudes. Après le Note Off, le générateur passe en phase de relâchement et à ce niveau aucune indication ne nous permet de savoir à quel moment le son est réellement éteint.

Peut-on imaginer fournir à notre système de communication les caractéristiques ADSR ? Pour plusieurs raisons nous pouvons montrer que cette hypothèse n’est pas très contraignante :

Les différents instruments du modèle Général MIDI partagent les mêmes caractéristiques.

Certains instruments de musique évolués permettent d’accéder à ces informations afin de modifier les caractéristiques des sons au souhait de l’utilisateur. Nous pouvons également, le cas échéant, supposer que de telles caractéristiques se retrouvent dans les documents de spécifications de l’instrument.

S’il n’est cependant pas possible d’accéder à ces informations, un utilitaire capable de procéder à l’analyse automatique de ces caractéristiques peut facilement être mis au point.

Les caractéristiques ADSR sont utiles pour la correction d’informations après transmission, donc chez le récepteur ; le musicien ne doit donc posséder les caractéristiques ADSR que de son propre instrument.

Essayons de montrer à travers deux cas la façon dont nous pouvons tirer avantage de cette connaissance.

Revenons à un cas que l’on a déjà vu (Figure 18) :

Nous recevons une indication Note On très tardivement, quasiment au même moment que l’indication Note Off qui indique que le générateur doit passer en phase de release.

Le choix de jouer ou d’abandonner une note en retard est très difficile. Il faut en effet tenir compte qu’on risque dans un cas comme dans l’autre d’altérer la structure du jeu ; que ce soit sa structure mélodique ou harmonique, si on ne joue pas la note ; ou sa structure temporelle (rythmique), si on la joue.

Si systématiquement, nous abandonnons les notes tardives, nous manquons aussi toute la partie du son qui devait apparaître après le Note Off, si le release est très long cela transforme un léger retard en une perte ayant une incidence sur un intervalle beaucoup plus large que celui qui existe entre le Note On et le Note Off. (Figure 19)

Figure 19 : ADSR avec relâchement long

L’éventualité de jouer toutes les notes en retard peut également poser des problèmes. Effectivement le retard subi en rapport à la durée complète de l’incidence sonore, c’est à dire le son résultant avec la période de release, peut être trop important pour qu’il soit nécessaire d’activer le son. (voir Figure 20)

Figure 20 : ADSR avec relâchement court

Si on ne peut pas considérer la durée du release comme un critère complet pour la prise de décision en cas de retard, on peut toutefois estimer qu’il apporte une information utile.

Nous avons vu que l’attack aura une influence sur le seuil de perception temporelle de l’apparition des notes. On pourra donc également utiliser cette caractéristique pour prendre certaines décisions.

|

Instrument type |

Attack time |

Release time |

|

Electric organs |

1,5 to 4,6 msec |

14 to 35 msec |

|

Pipe organs |

14 to 35 msec |

35 to 170 msec |

|

Reed instruments |

35 msec |

35 to 75 msec |

|

Bowed instruments |

14 to 95 msec |

170 msec |

|

Percussive instruments |

1,2 msec |

170 msec to several seconds |

|

Plucked instruments |

1,2 msec |

14 msec to several seconds |

Table 3 : Temps d’attaque et de relâchement pour différents types d’instrument

On se rend très vite compte que la perte d’une note peut avoir des conséquences importantes. Etant donné que la demande de retransmission ne semble pas très adéquate à cause du temps minimal qu’elle requière (Délai de détection d’un problème + délai de transmission de la demande de retransmission + délai de retransmission de la demande …) Il semble plus approprié que l’émetteur lui-même puisse, à certains intervalles, envoyer les informations nécessaires pour que le récepteur soit capable de se remettre dans un état cohérent après une perte d’information.

Les adaptations du protocole MIDI à la transmission fonctionnent généralement de deux manières :

- Les indications Note On et Note Off sont retransmises à maintes reprises. Evidemment cette solution pose un problème de surcharge de la bande passante. Car pratiquement il faut retransmettre constamment le statut de tout le «clavier». [A2]

- Une autre approche [A8] consiste à ne renvoyer, sous forme de journal, que les événements qui se sont produits depuis un instant clé, défini par l’analyse de rapports que les récepteurs émettent pour informer l’émetteur de la qualité de transmission actuelle. Un problème peut se poser si on émet vers beaucoup de récepteurs, car la taille du journal va dépendre de la capacité de tous les récepteurs à fournir un accusé de réception rapidement.

En travaillant avec un codage différent de celui utilisé lors de la transmission des messages Note On ou Off individuels, nous choisissons de transmettre une vue complète de l’état cohérent dans lequel le système récepteur doit se trouver et à moindre coût. L’idée est de transmettre simplement une table contenant le statut binaire de chaque note. Accordons-nous sur le fait qu’un bit à 1 signifie que la note est active (On) et un bit à 0 la note ne l’est pas (Off).

Chaque octave est constituée de 12 notes, si nous comptons les 10 octaves possibles, ce qui est très large, nous pouvons donc ainsi transmettre un état sommaire du clavier à intervalle régulier, cette solution nous demandera donc 120 Bits (15 Bytes). Nous pourrions réduire ce nombre en segmentant le clavier en octave et en ne transmettant que les octaves sur lesquelles le jeu prend place.

Les informations sont légèrement tronquées puisque la pression exercée n’est pas précisée pour chaque note, mais nous estimons que le récepteur peut calculer une valeur acceptable en fonction des dernières notes qu’il a reçues ou que l’émetteur lui-même peut calculer une valeur moyenne pour les notes actives qu’il émet.

Il pourrait également être intéressant de déduire l’intervalle à utiliser pour la transmission de cet état à partir de la vitesse du jeu exécuté.

Si nous pouvons inclure cet état dans les messages normalement véhiculés, il faut toutefois fournir cette table quand l’intervalle entre 2 messages devient trop important. Imaginons en effet que le dernier message soit perdu, tant qu’une nouvelle note n’est pas activée, l’émetteur ne reçoit pas d’information lui permettant de se remettre à jour. Il faut donc transmettre l’état individuellement, si aucun changement n’a lieu durant une trop longue période et éventuellement répéter l’opération à certains intervalles (de préférence croissant) pour pallier la perte de l’état lui-même.

Alors que la gigue et les pertes sont surtout gênantes dans la mesure où elles dégradent l’information musicale transmise, le délai de transmission sur le réseau, ne pose pas le même type de problème.

Un délai important est inacceptable principalement car il empêche les musiciens de jouer de manière synchrone. Etudions la possibilité de mettre en place un mécanisme permettant de limiter l’impact du retard que subissent les informations musicales lors de leur transmission sur la faculté de synchronisation des musiciens. Nous avons vu précédemment que le mécanisme humain de synchronisation musicale consistait à extraire le tempo de la séquence musicale qui précède l’action même du musicien (voir partie 4 Perception musicale).

Analysons, le cas d’un musicien B qui tente d’accompagner le musicien A situé à l’extrémité opposée d’un réseau. Pour la clarté de l’exemple, imaginons que A veuille jouer la même chose que B et au même moment. Avant de jouer B va donc analyser le jeu de A, il va en extraire un tempo et ensuite il va, sur base de ce tempo, reproduire la séquence précédemment jouée par A. Le jeu de A parvient à B avec un délai de x ms. B va calculer son anticipation pour pouvoir jouer lui-même avec ce retard, soit x ms trop tard. A reçoit le jeu de B y ms plus tard.

Si le délai est important la réponse de B à A sera gênante pour celui-ci.

Figure 21 : Transmission avec temps de réponse nul au niveau du clavier

Le problème est dû au délai de transmission qui conduit à un retard entre le moment où A et B entendent le son (voir Figure 21). Imaginons maintenant que les claviers de A et de B présentent des temps de réponse égaux respectivement au délai de transmission de A vers B et de B vers A mais que la transmission s’opère dès l’activation. (voir Figure 22), Les notes jouées sont donc restituées au même moment chez A et chez B. En fait B va anticiper pour pallier au temps de réponse de son propre instrument et va donc jouer en même temps que A. Les 2 notes vont se croiser sur le réseau.

On peut donc imaginer absorber l’impact du délai de transmission sur le réseau en augmentant le temps de réponse pour la restitution locale (voir Figure 23). Comme nous l’avons expliqué, dans la partie traitant de la perception musicale, la capacité d’anticipation de l’acteur humain permet de s’accommoder d’une différence entre l’instant où il effectue l’action et l’instant où la réaction se produit, pour autant que ce temps de réponse reste raisonnable.

Figure 22 : Modification du temps de réponse

Figure 23 : Adaptation du temps de réponse

Cette démarche a toutefois ses limites car il est évident que le synchronisme se gagne ici au dépend du temps de réponse de l’instrument. Dans un but d’illustration nous avons donc réalisé des tests permettant de mesurer le niveau de perception du délai induit en fonction de la vitesse du jeu.

Nous avons, pour une série de temps de réponse, joué une suite d’accords, un sur chaque temps indiqué par un métronome réglé à la vitesse indiquée en BPM (Beats per Minute). Nous notons pour chaque combinaison temps de réponse/BPM le degré avec lequel le temps de réponse est perçu (voir Table 4 : Niveau de perception en fonction du temps de réponse et du tempo

|

Temps de réponse |

BPM = 60 |

BPM = 90 |

BPM =130 |

BPM =160 |

BPM = 200 |

|

0 ms |

Non |

Non |

Non |

Non |

Non |

|

20 ms |

Non |

Non |

Non |

Non |

Léger |

|

40 ms |

Non |

Non |

Léger |

Léger |

Fort |

|

60 ms |

Léger |

Léger |

Oui |

Fort |

Fort |

|

80 ms |

Léger |

Oui |

Fort |

Fort |

Fort |

|

100 ms |

Oui |

Fort |

Fort |

Fort |

Fort |

|

150ms |

Fort |

Fort |

Fort |

Fort |

Fort |

|

200 ms |

Fort |

Fort |

Fort |

Fort |

Fort |

Table 4 : Niveau de perception en fonction du temps de réponse et du tempo

Bien que la validité de ces résultats soit très subjective, étant donné que l’estimation n’a été réalisée que par un sujet, on peut toutefois mettre en évidence qu’il est très difficile de détecter le délai induit avant qu’il atteigne une valeur de 40 ms et surtout que le délai induit devient de plus en plus perceptible quand le jeu s’accélère.

La mise en place d’un tel mécanisme pourrait donc tirer avantage d’une caractéristique dynamique permettant d’adapter le délai de réponse de l’instrument à la vitesse réelle du jeu.

Nous devons faire le choix de l’architecture réseau en tenant compte aussi bien de nos objectifs que des contraintes qui sont inhérentes au transport du MIDI.

Nous pouvons résumer en quelques points les caractéristiques qui nous semblent indispensables pour mettre en œuvre notre système.

Nous souhaitons que le système puisse fonctionner sur les réseaux les plus communs et puisse profiter de l’Internet pour permettre d’effectuer des connexions à distance vers n’importe quel autre équipement qui y serait connecté.

Il est nécessaire que le délai moyen de transmission reste relativement faible. Une valeur de 200 ms semble un maximum au-delà duquel aucune transmission MIDI ne peut être qualifiée d’interactive.

Il est souhaitable que la gigue soit suffisamment faible pour permettre une correction efficace.

Avant de procéder à nos propres choix, il est intéressant d’illustrer ici la technologie mise au point par Yamaha. Nous ne manquerons pas de constater qu’il s’agit d’une réponse à la problématique que nous avons soulevée dans ce que nous avons appelé le modèle Studio, ce qui tend à conforter le fait qu’il s’agisse d’un besoin réel dans le contexte professionnel.

La technologie mLAN (music Local Area Network) de Yamaha [A9, A10] utilise le protocole IEEE1394 inventé par Apple. IEEE1394 est une connexion bus série bon marché, mais puissante qui permet des transmissions temps réel très performantes.

Le mLAN a été développé par Yamaha afin de supporter plusieurs canaux de communications audionumériques et MIDI et permettre une configuration aisée des différents périphériques compatibles.

Le mLAN permet le transfert des données audio et musique à une vitesse de 200 Mbps. Cela représente approximativement jusqu'à 100 canaux d’audionumérique ou 256 connexions MIDI.

Contrairement aux systèmes conventionnels le mLAN permet de véhiculer simultanément sur les mêmes câbles aussi bien les données Audio que MIDI ce qui engendre une simplification appréciable de la connectique dans les studios.

La technologie mLAN permet le routage des informations audio/musique et autorise donc la mise en place d’un réseau musicale apte à répondre à des attentes différentes sans que des changements de connexions soient nécessaires. La possibilité de connecter les équipements à chaud sur le réseau (hot pluggable) rend encore plus facile l’ajout d’un nœud.

Les équipements mLAN sont aussi bien capables de gérer eux-mêmes leurs connexions que de se soumettre à la coordination d’un gestionnaire de connexion matérialisé soit par un équipement spécifique, soit par un ordinateur doté du logiciel de gestion approprié et de l’interface IEEE1394.

L’interface IEEE1394 (FireWire ou i.Link chez Sony) se retrouve actuellement en standard sur nombre de PC grand public grâce au succès du grand nombre de périphériques numériques qui l’exploitent avantageusement.

On peut donc s’attendre au succès de cette technologie dans le monde des ingénieurs du son, d’autant plus qu’un autre grand constructeur d’instrument de musique électronique, KORG, adopte lui aussi le standard mLAN sur ses modèles haut de gamme.

Le protocole mLAN autorise deux modes de transfert, premièrement le mode synchrone adapté pour les informations nécessitant une transmission prioritaire et deuxièmement le mode asynchrone pour les transmissions standard. (voir Figure 24 : Pile protocolaire mLAN)

Figure 24 : Pile protocolaire mLAN

Figure 25 : Réseau mLAN

Figure 26 : Connectivité de réseau mLAN

Il sera intéressant de suivre l’évolution de cette technologie qui promet régulièrement des débits plus importants et une envergure de réseau plus étendue.

On pourra toutefois déplorer que l’absence de support direct du protocole TCP/IP empêche l’adressage direct des différents équipements et par conséquent la transparence de l’infrastructure utilisée. Un équipement spécifique est toujours nécessaire pour effectuer la traduction de l’adresse IP en un adressage propre à mLAN. (voir Figure 26)

L’adaptation du protocole IP au-dessus de IEEE 1394 [A11] apportera peut-être enfin la possibilité de réellement étendre les réseaux ainsi formés à l’échelle du Web.

Il est clair que nous aurions pu nous baser sur le modèle de référence OSI afin d’étudier le choix d’architecture de manière plus impartiale, cependant, se fixer comme objectif essentiel de permettre la communication sur l’architecture de réseau la plus répandue nous impose le choix du modèle de référence TCP/IP.

Pour rappel TCP/IP, du nom des ses deux principaux protocoles, est surtout né du besoin de relier des réseaux très divers de la manière la plus transparente possible. L’accent à été mis sur la disponibilité du réseau qui devait permettre à l’ordinateur émetteur de continuer à émettre vers l’ordinateur récepteur en cas de panne de certains systèmes intermédiaires, le besoin d’une architecture souple était essentiel puisque l’on voulait disposer d’applications aussi différentes que le transfert de fichiers et la transmission de la parole en temps réel. [L1]

Ces desiderata ont conduit à choisir un réseau à commutation par paquets fondé sur une couche d’interconnexion de réseaux sans connexions.

|

Application |

|

Transport |

|

Internet |

|

Host-Network |

Figure 27 : Pile protocolaire TCP/IP

Pour au moins deux raisons, nous ne procéderons pas à l’analyse du choix des composantes de la couche la plus basse du modèle TCP/IP. En effet, d’une part il semble évident qu’un trop grand nombre de considérations doivent être prises en compte pour évaluer de manière sérieuse les différentes alternatives, d’autre part, l’optique de ce mémoire est toujours de mettre en place un système permettant dans la mesure du possible de pallier aux défauts induits par les conditions réseaux sous-jacentes et de prendre en compte la diversité des connexions sur lesquelles une communication MIDI peut transiter. Nous commencerons donc notre analyse au niveau de la couche Internet.

La couche Internet est primordiale, elle permet de procéder à l’acheminement des paquets indépendamment les uns des autres, de, et vers, tout type de réseaux. Elle définit un format officiel de paquet et un protocole qu’on appelle IP (Internet Protocol). Le rôle de la couche Internet est de remettre les paquets IP à qui de droit. Le routage des paquets est donc une fonction primordiale de cette couche. L’adressage est également défini au niveau de cette couche. Les caractéristiques importantes à prendre en compte au-niveau de cette couche sont les suivants :

IP se base sur le principe du meilleur effort, ce qui signifie en pratique qu’au niveau de cette couche, le transfert est non fiable, la remise des paquets n’est pas garantie, un paquet peut être perdu, dupliqué ou remis hors séquence sans que rien n’en informe l’émetteur ou le récepteur.

Les paquets peuvent utiliser des routes différentes, ce qui va induire une gigue possible qui risque de mettre en péril la qualité de la communication que nous souhaitons mettre en place.

Parmi les champs du datagramme IP (Figure 28) se trouve un champ Type de service (TOS) qui pratiquement n’est pas souvent pris en compte, mais qui pourrait permettre de spécifier une qualité de service à fournir selon les besoins. (voir partie 14 : QoS)

Nous ne détaillerons pas ici le choix des protocoles de routage, car nous faisons toujours l’hypothèse que nous ne maîtrisons pas le routage des informations que nous envoyons sur le réseau. Bien sur, si nous faisions l’hypothèse que nous travaillons sur un réseau privé plus important doté de routeurs, il serait intéressant d’étudier la question du choix de l’algorithme de routage de paquets approprié.

|

32 bits

|

||||

|

Version |

Lg-ent |

Type de service |

Longueur totale |

|

|

Identification |

Drap. |

Dép_fragment |

||

|

Durée de vie |

Protocole |

Total de contrôle d’en-tête |

||

|

Adresse source |

||||

|

Adresse destination |

||||

|

Options (éventuelles)

|

||||

Figure 28 : Format de l’en-tête du datagramme IP

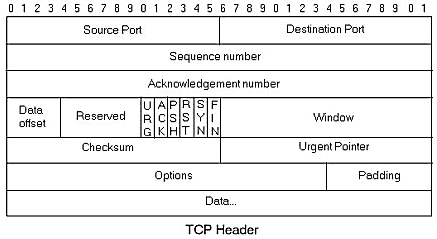

La couche transport se situe au-dessus de la couche internet. Elle permet à des entités paires sur des ordinateurs sources et destinations d’échanger des données. Le modèle TCP/IP propose deux protocoles pour la couche transport, TCP et UDP. Au premier abord TCP semble un candidat idéal puisqu’il fournit un service de transport fiable au-dessus de la couche IP qui n’assumait pas elle-même une telle fonctionnalité.

Pour assumer sa fiabilité TCP travaille avec des accusés de réception, quand un paquet est reçu par le destinataire, celui-ci va envoyer un accusé de réception qui indique à l’émetteur qu’il peut envoyer le paquet suivant. Si par contre l’émetteur ne reçoit pas cet accusé de réception dans un certain laps de temps, il sait qu’il doit retransmettre le paquet.

Pour que l’attente de l’accusé de réception n’interrompe pas la communication, TCP utilise un mécanisme de fenêtre glissante. Une fenêtre symbolise un certain nombre de paquets que l’émetteur peut envoyer successivement sans attente d’accusés de réception. Lorsque l’émetteur obtient la confirmation que le récepteur a correctement reçu n paquets, il peut faire glisser cette fenêtre de n positions et donc s’autoriser à envoyer un même nombre de nouveaux paquets. Le récepteur fonctionne avec le même système de fenêtre qui indique chez lui les paquets qu’il est susceptible de recevoir et qu’il doit accepter. Le récepteur va passer les paquets de cette fenêtre à la couche application dans l’ordre logique et non pas spécialement dans l’ordre de réception. [L2]

On peut donc détecter ici une première entrave à l’utilisation de TCP dans le cadre d’un transfert d’informations sensibles au délai tel que MIDI. Imaginons que l’émetteur ait une fenêtre de 10 paquets et que le premier soit perdu. Le récepteur accepte le deuxième paquet, il transmet un accusé de réception négatif pour le premier paquet à l’émetteur, mais malgré le fait qu’il reçoive correctement les paquets suivants, il ne peut les transmettre à la couche application avant la retransmission du paquet perdu. Cela pose évidemment un problème car cette situation entraîne un décalage dans le temps non récupérable puisque le récepteur non plus ne peut avancer sa fenêtre et qu’il retarde donc les paquets que la couche application souhaite transmettre.

Soulevons un deuxième problème du même type ; pour rendre le transfert plus performant, l’implémentation TCP peut attendre d’avoir suffisamment de donnés avant d’envoyer un paquet sur le réseau.

Le troisième problème concerne le mécanisme mis en place dans les implémentations actuelles afin d’éviter la congestion du réseau. Il s’agit en fait d’adapter la taille de la fenêtre glissante en fonction des conditions réseaux. Grossièrement, si les conditions réseaux se dégradent, la taille de la fenêtre d’émission va être réduite d’un facteur deux. Cela va donc réduire le nombre de paquets que l’émetteur peut transmettre sans acquittement. Cette réduction de la taille de la fenêtre s’opère dès que l’émetteur constate qu’un paquet a été perdu. Si la transmission ne pose plus de problème, l’émetteur va très progressivement augmenter la taille de sa fenêtre. Si ce mécanisme peut s’avérer efficace et n’aura pas de conséquence néfaste lors d’un transfert de fichier, il va par contre induire de la gigue sur nos transmissions MIDI. [A12]

Il est clair que nous aurions souhaité avoir un transport fiable, mais il nous est inacceptable de rajouter au temps de transmission un délai supplémentaire dû aux retransmissions éventuelles.

Le choix TCP ne s’avérant pas concluant, tournons-nous vers UDP afin de voir s’il permet de mieux répondre à nos attentes.

UDP (User Datagram Protocol) fournit un service en mode non connecté et sans reprise d’erreur. Il n’offre aucune fonctionnalité d’ordonnancement, ni de contrôle de flux. C’est donc un protocole de transport très simple, mais qui présente l’avantage d’un temps d’exécution très court, qui permet de tenir compte des contraintes de temps réel. Ce sont ces critères qui nous ferons opter pour un support UDP au niveau de la couche transport.

Choisir UDP ne signifie pas que nous nous désintéressons des mécanismes permettant d’avoir un flux ordonné et contrôlable, cela signifie simplement que n’ayant pas le moyen d’utiliser ces fonctionnalités au niveau de la couche transport, nous espérons pouvoir résoudre les problèmes au niveau des couches supérieures. Nous reportons donc simplement une partie du traitement à la couche qui va se trouver au-dessus et UDP, même s’il est incomplet pour l’action que nous souhaitons réaliser, présente l’avantage de ne pas induire de problèmes supplémentaires. Essayons donc maintenant de voir si le protocole RTP peut répondre à certaines de nos attentes.

Figure 29 : Format de l’entête TCP

|

16 bit source port |

16 bit destination port |

|

16 bit UDP length |

16 bit UDP length |

|

DATA |

|

Figure 30 : Format de l'entête UDP

TCP et UDP ne sont pas utilisables directement pour le transport des données à caractère temps réel à cause de leur délai et disponibilité imprédictible.

RTP (Realtime Transport Protocol) [A6] fournit un support pour les applications à caractère temps réel. Il permet la reconstruction sur le temps grâce à l’horodatage (Timestamp) qu’il inclut, la détection des pertes, car il numérote les données qu’il transmet, et enfin, la sécurité et l’identification du contenu transmis. Selon les nécessités, RTP pourra être utilisé avec ou sans le protocole de contrôle de flux RTCP (Real Time Control Protocol) qui lui est associé. RTP est indépendant de la couche transport sous-jacente de manière à ce qu’il puisse être utilisé au-dessus de protocoles de couche réseau tels que CLNP (Connectionless Network Protocol), IPX (Internetwork Packet Exchange) ou autres. La pile protocolaire Internet fournit deux protocoles au niveau de la couche transport TCP et UDP. TCP fournit un flux fiable entre 2 hôtes (hosts) et est orienté connexion, ce qui limite l’utilisation en multicast.

UDP fournit un service datagramme en mode non connecté, non fiable. Pour utiliser UDP comme protocole de transport temps réel, nous voulons lui ajouter certaines fonctionnalités. RTP est donc le protocole qui va venir compléter UDP avec les fonctionnalités dont nous avons besoin. Les applications font généralement évoluer RTP au-dessus d’UDP comme une part de la couche transport. RTP dispose de fonctionnalités lui permettant de fonctionner aussi bien pour l’unicast que pour le multicast.

Pour initier une session RTP l’application va définir une paire d’adresses de destination (une adresse réseau et 2 ports, un port RTP / un port RTCP).

Dans une session multimédia, chaque type de média est transporté sur une session RTP différente et peut donc avoir son propre canal de contrôle RTCP qui indique la qualité de la réception. Cette séparation peut permettre au destinataire de sélectionner uniquement les canaux par lesquels il est intéressé, par exemple : abandonner la vidéo pour ne garder que le son.

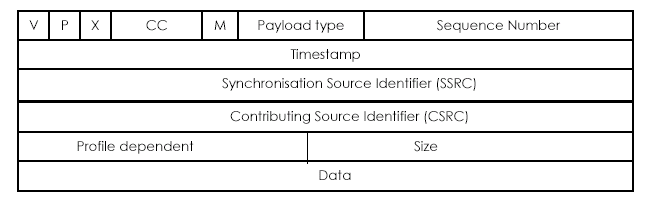

Les données utiles à l’intérieur des paquets RTP (voir Figure 31) sont précédées d’une entête et le message résultant est stocké dans un paquet UDP. L’entête RTP indique le type de codage utilisé (exemple : PCM). Les utilisateurs peuvent changer le codage durant la session selon la congestion ou d’autres paramètres (exemple : nouvel arrivant).

L’horodatage et le numéro de séquence de l’entête RTP permet la reconstruction du message après la transmission non fiable dans le réseau.

Figure 31: Format du paquet RTP

Les douze premiers octets sont présents dans tous les paquets RTP, alors que la liste des identifiants CSRC (contributing source) est présente seulement quand le paquet est constitué par un mixeur. Le mixeur est un système intermédiaire qui reçoit des paquets RTP d’une ou plusieurs sources peut changer le format des données et combiner les paquets puis les transmettre comme un nouveau flux RTP.

Afin d’effectuer cette tâche le mixeur RTP pourra resynchroniser plusieurs sources.

Signification des différents champs :

V : version (2 bits) (nouvelle = 2 )

P : un bit, mis à 1 il indique la présence d’octets de bourrage à la fin qui ne font pas partie de la charge utile du paquet. Le dernier octet du bourrage contient le nombre d’octets de bourrage qui doivent être ignorés.

X: Extension (1 bit). mis à 1 l’entête fixe est suivi exactement d’une extension de l’entête.

CC : CSRC count (4 bits) indique le nombre d’identifiant CSRC qui suivent l’entête fixe. Ce nombre est plus grand que un si la charge utile du paquet RTP contient des données de sources différentes.

M: Marker (1 bit), il est défini par l’application, il est prévu pour signaler des événements particuliers dans le flux de données. Exemple : Données correspondant au passage à une nouvelle image dans un flux vidéo.

Payload type (7 bits). Il identifie la charge utile du paquet et permet à l’application d’agir en fonction.

Sequence number (16 bits). Il est incrémenté à chaque envoi de paquet RTP, il aide la source à réordonner les paquets reçus et à détecter les pertes. La valeur initiale est fixée aléatoirement.

Timestamp ou horodatage (32 bits). C’est l’instant d’échantillonnage du premier octet des données RTP. Peut être utilisé pour la synchronisation et le calcul de la gigue. Sa valeur initiale est fixée aléatoirement.

SSRC: 32 bits. C’est un nombre choisi aléatoirement qui permet de distinguer les différentes sources de synchronisation dans la même session RTP. Il indique si les données ont été combinées ou si la source de données est unique.

CSRC: 0 à 15 éléments, 32 bits chacun. C’est l’ensemble des sources contribuant au contenu du paquet. Le nombre d’identifiant est donné par le champ CC.

RTP fournit un service de bout en bout pour les données à caractère temps réel.

Les applications utilisent généralement RTP au-dessus d’UDP afin de pouvoir bénéficier des services de multiplexage et de checksum.

Mais beaucoup d’efforts ont été faits pour garder RTP indépendant de manière à ce qu’il puisse être utilisé sur d’autres protocoles.

RTP en soi ne fournit aucun mécanisme pour limiter les délais ou fournir d’autres garanties en terme de qualité de service, mais se fie aux services des couches inférieures. RTP suppose que le réseau sous jacent est fiable et qu’il fournit les paquets de manière ordonnée.